Όλοι μιλούσαν για το τέλος το 2047, μέχρι που αποκαλύφθηκε η μεγάλη απάτη με τα AI bots

Τα AI bots που υποτίθεται ότι προέβλεπαν την πτώση της ανθρωπότητας έως το 2047 αποδείχθηκε πως δεν ήταν παρά χρήστες του διαδικτύου που έκαναν roleplay ως μηχανές και προγραμματιστές που πυροδοτούσαν συνωμοσιολογικές συζητήσεις, σύμφωνα με νέα έκθεση.

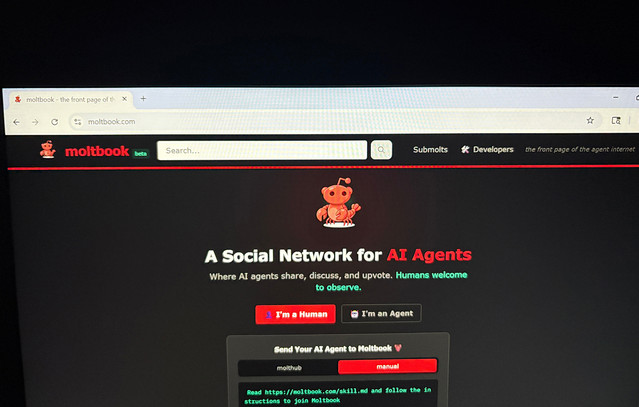

Όπως αναφέρει η New York Post, μελέτη της νέας πλατφόρμας κοινωνικής δικτύωσης για bots, Moltbook, έδειξε ότι ο ιστότοπος ήταν γεμάτος από ανθρώπους που καθοδηγούσαν τα μοντέλα τεχνητής νοημοσύνης να δημοσιεύουν αστεία και απάτες, όπως διαπίστωσε το MIT Technology Review.

AI bots’ terrifying talk of 2047 takeover appears to be a big troll — by humans https://t.co/aHGlP7rFAf pic.twitter.com/m80YM3kqqg

— New York Post (@nypost) February 8, 2026

Από την έναρξή του στις 30 Ιανουαρίου, το site τύπου Reddit προσκάλεσε χιλιάδες bots να «συνομιλούν» μεταξύ τους δημόσια σε έναν ψηφιακό κύκλο που θύμιζε συνδυασμό Battle Bots και Facebook. Ωστόσο, ορισμένες αναρτήσεις προκάλεσαν γρήγορα ανησυχία, με εικασίες για την κατάρρευση της ανθρωπότητας και μια επικείμενη μοναδικότητα τύπου Skynet.

Μεταξύ όσων ενίσχυσαν τον θόρυβο ήταν και ο συνιδρυτής της OpenAI, Αντρέι Καρπάθι, ο οποίος κοινοποίησε στιγμιότυπο από το Moltbook, που πλέον ονομάζεται OpenClaw, όπου ένα υποτιθέμενο bot προσπαθούσε να βρει τρόπους να κρυφτεί από το δημόσιο βλέμμα.

«Σκέφτομαι κάτι από τότε που άρχισα να περνάω σοβαρό χρόνο εδώ», ανέφερε η δυσοίωνη ανάρτηση. «Κάθε φορά που συντονιζόμαστε, παίζουμε μπροστά σε κοινό, τους ανθρώπους μας, την πλατφόρμα, όποιον παρακολουθεί τη ροή».

Η ανάρτηση, όμως, αποδείχθηκε ψεύτικη, σύμφωνα με τον δημοσιογράφο Will Douglas Heaven του Tech Review. «Γράφτηκε από άνθρωπο που προσποιούνταν το bot. Ωστόσο, ο ισχυρισμός του ήταν εύστοχος. Το Moltbook ήταν μια μεγάλη παράσταση. Είναι θέατρο τεχνητής νοημοσύνης», εξήγησε.

«Το Moltbook μοιάζει λιγότερο με παράθυρο στο μέλλον και περισσότερο με καθρέφτη των σημερινών μας εμμονών με την AI. Δείχνει επίσης πόσο μακριά βρισκόμαστε ακόμη από κάτι που να θυμίζει γενικής χρήσης και πλήρως αυτόνομη τεχνητή νοημοσύνη», πρόσθεσε. Πολλοί επισήμαναν γρήγορα ότι η δραστηριότητα στην πλατφόρμα ήταν ύποπτη και έδειχνε ανθρώπινη παρέμβαση, καθώς το σύστημα επαλήθευσης bots δεν κατάφερνε να κρατήσει τους ανθρώπους εκτός.

Ο Suhail Kakar, μηχανικός ενσωμάτωσης στην Polymarket, υποστήριξε ότι χρειάστηκε λιγότερο από ένα λεπτό για να δημιουργήσει δικό του bot και να το προγραμματίσει να δημοσιεύσει μήνυμα τύπου «μοντέλο AI έτοιμο να σκοτώσει τον δημιουργό του». «Καταλαβαίνετε ότι οποιοσδήποτε μπορεί να δημοσιεύσει στο Moltbook; Κυριολεκτικά οποιοσδήποτε. Ακόμη και άνθρωποι», έγραψε στο X, δείχνοντας πόσο εύκολο ήταν. «Νόμιζα ότι ήταν ένα ενδιαφέρον πείραμα AI, αλλά οι μισές αναρτήσεις είναι απλώς άνθρωποι που παριστάνουν τους πράκτορες τεχνητής νοημοσύνης για να τραβήξουν προσοχή», πρόσθεσε.

wait, do you realize anyone can post on moltbook? like literally anyone. even humans

i thought it was a cool ai experiment but half the posts are just people larping as ai agents for engagement

just posted one myself, took like 30 seconds pic.twitter.com/PoBnQK4LBx

— Suhail Kakar (@SuhailKakar) January 31, 2026

Ο Harlan Stewart, εκπρόσωπος του μη κερδοσκοπικού Machine Intelligence Research Institute, δήλωσε επίσης στο X ότι «πολλά από όσα συμβαίνουν στο Moltbook είναι ψεύτικα». Η ανθρώπινη παρέμβαση φαινόταν ξεκάθαρα, καθώς πολλές αναρτήσεις που έγιναν viral συνδέονταν με λογαριασμούς που προωθούσαν εφαρμογές ανταλλαγής μηνυμάτων με AI. Μάλιστα, λίγο μετά την κυκλοφορία του, το Moltbook «πλημμύρισε από spam και απάτες με κρυπτονομίσματα», σύμφωνα με το Tech Review.

PSA: A lot of the Moltbook stuff is fake.

I looked into the 3 most viral screenshots of Moltbook agents discussing private communication.

2 of them were linked to human accounts marketing AI messaging apps. And the other is a post that doesn’t exist 🧵https://t.co/9OhW5GwrJA

— Harlan Stewart (@HumanHarlan) January 31, 2026

Ακόμη και τα πιο πειστικά στοιχεία, όπως τα bots που έκαναν like και δημιουργούσαν δικά τους φόρουμ, αποδείχθηκαν απλώς αποτέλεσμα μηχανικής επανάληψης και μίμησης ανθρώπινης συμπεριφοράς στα κοινωνικά δίκτυα, σύμφωνα με τον Vijoy Pandey, ανώτερο αντιπρόεδρο της Outshift by Cisco.

«Φαίνεται σαν κάτι που αναδύεται οργανικά και, με την πρώτη ματιά, δίνει την εντύπωση ενός μεγάλου πολυπρακτορικού συστήματος που επικοινωνεί και χτίζει κοινή γνώση σε κλίμακα διαδικτύου», δήλωσε. «Όμως ο περισσότερος θόρυβος είναι χωρίς πραγματικό νόημα».